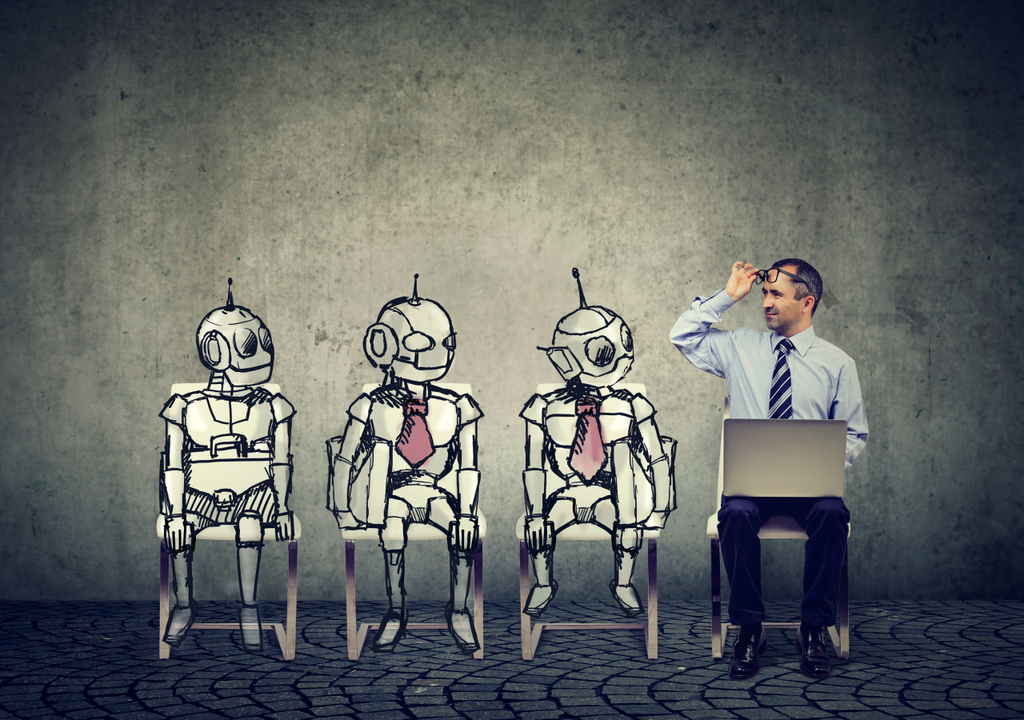

Warum scheinen KI-generierte Dinge immer mehr vom Gleichen zu sein?

Wenn wir etwas sehen, das von künstlicher Intelligenz erzeugt wurde, haben wir den Eindruck, dass wir es schon einmal gesehen haben. Das liegt an etwas, das hinter fast allen heutigen Tools steckt.

Wenn man etwas, das von künstlicher Intelligenz geschaffen wurde, betrachtet, sei es ein Bild oder ein Text, hat man den Eindruck, es schon einmal gesehen zu haben. Bilder sehen nicht originell aus und Texte sehen aus wie andere Texte.Der Mangel an Kreativität bei Dingen, die von künstlicher Intelligenz erzeugt werden, ist eine ständige Debatte in sozialen Netzwerken und in Artikeln.

Der Grund für diesen Eindruck liegt in der Art und Weise, wie diese Werkzeuge entwickelt und trainiert werden. Maschinelles Lernen - oder Maschinelles Lernen - ist das Geheimnis hinter fast allen aktuellen Modellen, und gleichzeitigbringt es eine Einschränkung in den Ergebnissen. Beim maschinellen Lernen lernt das Modell durch Beobachtung von Mustern in den Daten, die es erhalten hat.

Da die eingegebenen Daten in der Regel von Menschen erstellt wurden, kann das Modell nur Muster und Beziehungen zwischen Dingen lernen, die bereits existieren. In letzter Zeit hat sich eine Diskussion über die Verwendung von Künstlerdaten entwickelt, und es wurden wichtige Punkte angesprochen. Die Diskussion zeigt, dass der Einsatz von maschinellem Lernen in der generativen künstlichen Intelligenz das Problem hinter diesen Fragen sein könnte.

IA x IA Generativa

Seit ChatGPT populär geworden ist, ist die generative künstliche Intelligenz das am heftigsten diskutierte Thema in der Gemeinschaft der künstlichen Intelligenz. In der Tat haben große Technologieunternehmen ihre Ressourcen und Investitionen auf den Bereich der generativen künstlichen Intelligenz konzentriert. Ihre Popularität ist so groß geworden, dass Künstliche Intelligenz und generative künstliche Intelligenz häufig verwechselt werden.

Innerhalb der künstlichen Intelligenz gibt es weitere Bereiche wie Prädiktion, Klassifikation, Regression und andere. Jeder Bereich hat andere Ziele, und der Teil der Datengenerierung, der zu generativ gehört, ist nur eine von mehreren Anwendungen. In jüngster Zeit hat sich das Potenzial der Generativität durch die Einführung von Transformatoren erheblich erweitert.

Maschinelles Lernen

In fast allen Bereichen wird das maschinelle Lernen eingesetzt. Maschinelles Lernen bezieht sich auf eine Reihe von Techniken, die eine Maschine durch die Beobachtung von Mustern erlernt. Die Idee ist, eine große Menge an Daten in ein Modell einzuspeisen, das lernt, Muster und Beziehungen zwischen den Daten zu erkennen.

Es gibt zwei gängige Arten des Lernens: überwachtes und unüberwachtes Lernen. Überwacht bedeutet, dass es eine Eingabe und eine Ausgabe mit der Antwort gibt und die Maschine die Beziehung zwischen der Eingabe und der Ausgabe durch eine Funktion lernt. Unüberwacht bedeutet, dass die Maschine Eingabedaten erhält und die Beziehungen selbständig erlernt.

Wie lernt die generative künstliche Intelligenz?

Im Falle der künstlichen Intelligenz kann es eine Kombination aus beiden Arten des Lernens und sogar das sogenannte halbüberwachte Lernen geben. Einige generative Lerntechniken der künstlichen Intelligenz beruhen auf der Beobachtung von Mustern und deren Rekonstruktion, wie zum Beispiel menschliche Gesichter. Eine solche Technik sind generative neuronale Netze (GANs).

Im Jahr 2017 führte Google neben Transformatoren auch Aufmerksamkeitsebenen ein. Die Idee ist, dass während dieser Musterbeobachtung Aufmerksamkeitsebenen verwendet werden, um wichtige Regionen in einem Bild oder Text zu priorisieren. Einige Arten von Transformatoren lernen durch Überwachung, wie einige Arten von Übersetzern, während andere eine Kombination von Methoden verwenden.

Warum scheint es so, als wäre alles immer dasselbe?

Da maschinelles Lernen die am weitesten verbreitete Technik in den heutigen Tools ist, lernen sie aus bereits vorhandenen Daten. Texte, Bilder, Videos, die sie bereits während des Trainingsprozesses gesehen haben. Auf diese Weise lernen diese Modelle Muster, die sie bereits kennen, und verknüpfen sie, um etwas zu schaffen.

Da die künstliche Intelligenz auf diesen bekannten Mustern basiert, ist es nur natürlich, dass die von ihr erzeugten Dinge nicht originell erscheinen. Dies ist ein ständiger Kritikpunkt vieler Menschen, und der Grund dafür ist, dass die Lernmethode selbst die Schaffung neuer Dinge begrenzt. Gegenwärtig ist es nur möglich, Beziehungen zu bestehenden Dingen herzustellen.

Kontroverse

Einer der Hauptkritikpunkte ist die Frage des Urheberrechts, da viele dieser Tools anhand von Daten aus dem Internet trainiert werden und lernen. Diese Daten stammen oft von Kunstwerken von Künstlern, die als Modell verwendet werden, um den Stil des Künstlers zu reproduzieren. Auf diese Weise würde das Tool nicht etwas erschaffen und einfach den Stil kopieren.

Das hängt auch mit der Einschränkung zusammen, dass Werkzeuge nichts Originelles schaffen können und der Stil oft eine Kopie des Künstlers ist. Ein weiterer Punkt ist, dass diese Werkzeuge ohne menschliche Kunst an eine Grenze stoßen, da sie nicht in der Lage sind, etwas Neues zu schaffen.